No hay advertencias en search console. No hay notificaciones de error. El contenido simplemente desaparece para el buscador.

Este no es un cambio repentino de política, sino una clarificación documental que separa los límites generales de rastreo (15 MB para la infraestructura de crawlers de google) del umbral específico de googlebot para búsqueda web (2 MB de html descomprimido). Sin embargo, el impacto estratégico es enorme, porque redefine quién gana posiciones en 2026: ya no es suficiente escribir mejor que la competencia; ahora es imprescindible estructurar el código de forma más eficiente.

En Presticorp hemos auditado decenas de sitios corporativos y la conclusión es clara: la mayoría de las webs modernas están infladas hasta el absurdo. Page builders pesados, css inline interminable, javascript innecesario y plugins que nadie auditan convierten a googlebot en un lector parcial. Si tu contenido estratégico cae después de esos 2 MB, para google es como si no existiera. Y tú, sin saberlo, compites con una desventaja brutal.

La confusión inicial en la comunidad seo fue comprensible. Durante años, la documentación de google mencionaba un límite de 15 MB que muchos interpretaban como el techo para html. En febrero de 2026, google actualizó tres veces su documentación en nueve días para precisar la distinción entre dos fases del rastreo: la descarga (fetching) y el procesamiento para indexación (indexing).

En la fase de descarga, los crawlers de google pueden obtener hasta 15 MB de un archivo. En la fase de indexación para búsqueda web, googlebot solo evalúa los primeros 2 MB de html descomprimido. Esto significa que, si tu página pesa 5 MB de html, google puede descargarla completa, pero solo utilizará 2 MB para determinar qué indexar y cómo posicionarla. El resto es invisible para los resultados de búsqueda.

John Mueller, analista de búsqueda de google, aclaró en bluesky que estos límites no son nuevos, sino que google simplemente quería documentarlos con mayor detalle. Sin embargo, la falta de advertencias cuando se produce el truncamiento convierte a este límite en un problema silencioso y peligroso. No recibirás un mensaje de error en search console. Tu página aparecerá como indexada, pero con contenido incompleto.

Según datos del http archive web almanac, la mediana del peso html en móvil es de aproximadamente 33 KB. Esto implica que el 90% de las páginas están muy por debajo del umbral. Pero el problema no es estadístico; es cualitativo.

Las páginas que sí superan 2 MB suelen ser las más importantes del negocio: landings de producto con catálogos masivos, aplicaciones de una sola página (spa) con hidratación de datos inline, portales financieros con tablas de tarifas embebidas y sitios de comercio electrónico con variantes de producto infinitas. Es decir, justo donde más dinero está en juego.

Cuando googlebot alcanza los 2 MB de html descomprimido, detiene la descarga de forma abrupta. La porción ya obtenida (bytes 1 a 2,097,152) se envía a los sistemas de indexación y al servicio de renderizado web (wrs) como si fuera el archivo completo. Los bytes restantes no se procesan, no se renderizan y no se indexan.

Es crucial entender que el límite se aplica al html descomprimido. Incluso si tu servidor utiliza gzip o brotli para comprimir la transferencia, google mide el tamaño original del archivo una vez descomprimido. La compresión acelera la entrega al navegador, pero no engaña al crawler.

Los recursos externos referenciados en el html (css, javascript, imágenes) se descargan por separado y cada uno tiene su propio límite de 2 MB. Esto es una buena noticia: externalizar código inline a archivos separados libera presión sobre el presupuesto html. Sin embargo, las imágenes en base64, los estilos inline y los scripts embebidos directamente en el documento sí consumen ese presupuesto de 2 MB y pueden inflarlo de manera considerable.

Lo más peligroso del truncamiento es que la página sigue apareciendo en el índice, pero incompleta.

Los rich snippets generados por schema markup pueden dejar de mostrarse. Los enlaces internos del footer o la navegación secundaria desaparecen para el rastreador. El texto de las secciones finales (faqs, avisos legales, términos y condiciones) se vuelve invisible. Y si tu framework de javascript inyecta contenido dinámico mediante un script al final del body, ese contenido nunca será ejecutado por el motor de renderizado de google.

Aunque el 99% de los sitios no alcanza los 2 MB de html, los que sí lo hacen concentran escenarios de alto valor económico. Identificamos cinco perfiles de riesgo que deberían auditar sus páginas de inmediato.

Sitios de comercio electrónico con catálogos masivos. Las páginas de categoría que muestran cientos de productos con descripciones inline, atributos técnicos y reseñas de clientes pueden superar fácilmente 1 MB de html puro. Si a eso se suma el schema de producto para cada ítem, el umbral de 2 MB se alcanza con rapidez.

Aplicaciones de una sola página (spa) con renderizado del lado del servidor. Frameworks como next.js, nuxt o sveltekit inyectan un payload json masivo en una etiqueta script para la hidratación del cliente. Ese objeto __next_data__ (o equivalente) puede pesar varios cientos de KB. En páginas con muchos datos, supera 1 MB por sí solo.

Páginas con imágenes inline en base64 o svgs complejos. Una imagen codificada en base64 puede consumir 200 KB de html. Tres o cuatro de ellas son suficientes para agotar una porción significativa del presupuesto. Los svgs detallados embebidos directamente en el código tienen el mismo efecto.

Portales con css y javascript inline. Las páginas que incrustan estilos críticos y scripts directamente en etiquetas style y script, en lugar de externalizarlos, añaden peso innecesario al documento html. Los temas de wordpress mal optimizados son especialmente propensos a este problema.

Documentación técnica y contenido de larga forma concatenado. Algunos sitios publican guías extensas o reportes en una sola página infinita. Si el html resultante supera 2 MB, google solo indexará la introducción y dejará fuera las secciones finales, donde a menudo residen las conclusiones y los llamados a la acción.

La herramienta de inspección de url de search console no es fiable para detectar este problema. Utiliza el crawler google-inspectiontool, que opera con el límite de 15 MB de descarga, no con los 2 MB de indexación. Te mostrará el código fuente completo incluso si googlebot ya truncó el contenido durante la indexación.

Para verificar si tu sitio está en riesgo, sigue estos pasos:

1. Abre chrome devtools (f12) en tu navegador.

2. Ve a la pestaña network y filtra por doc.

3. Carga tu página y revisa la columna content (tamaño descomprimido).

4. Si el valor se acerca a 1.5 MB (el 75% del límite), ya estás en zona de alerta.

5. Para una verificación definitiva, busca en google una frase única ubicada al final de tu html. Si google no la encuentra, tu contenido está siendo truncado.

Otra prueba sencilla recomendada por el propio john mueller: copia un párrafo específico de la parte inferior de tu página, algo que no aparezca en ningún otro sitio, y búscalo entre comillas en google. Si no aparece, ese texto no está indexado.

Mientras lees esto, es probable que algún competidor esté limpiando su html y subiendo posiciones sin crear ni una línea de contenido nuevo. El límite de 2 MB no es una teoría; es una realidad documentada por google que está redistribuyendo el ranking en tiempo real.

No esperes a que el tráfico orgánico caiga para actuar. Contacta a presticorp hoy y programa una auditoría de indexación. Diagnosticamos si tu sitio está en riesgo de truncamiento, optimizamos tu presupuesto de rastreo y te devolvemos el control sobre lo que google realmente ve de tu negocio.

La solución no es crear más contenido, sino limpiar lo que ya existe. En Presticorp hemos observado que, cuando se reduce el peso del html, se prioriza el contenido crítico y se optimiza la carga, los resultados mejoran sin necesidad de publicar ni una línea nueva.

Externaliza todo lo posible. Mueve css y javascript a archivos separados. Cada recurso externo tiene su propio límite de 2 MB, por lo que externalizar libera espacio en el presupuesto html. Elimina las imágenes en base64 y reemplázalas por archivos referenciados normalmente.

Minifica el html. Elimina espacios en blanco, comentarios y atributos innecesarios. Utiliza herramientas de minificación que no rompan la estructura semántica.

Coloca lo importante al inicio. Los tags canónicos, el título, la meta descripción, el schema markup crítico y el contenido principal deben aparecer lo antes posible en el documento. Si algo esencial cae después de 2 MB, es invisible para google.

Reduce el payload de hidratación en spas. Si utilizas next.js, nuxt o similar, evalúa si todo el payload json es necesario para el renderizado inicial. Considera la paginación de datos o la carga diferida de secciones secundarias.

Audita tus plugins y temas. En wordpress y plataformas similares, desactiva plugins que inyecten código inline innecesario. Reemplaza page builders excesivamente pesados por estructuras más limpias o código customizado cuando el retorno de inversión lo justifique.

Implementa compresión del lado del servidor. Aunque gzip y brotli no reducen el límite de 2 MB, sí mejoran la velocidad de transferencia, lo que indirectamente beneficia el crawl budget y la experiencia de usuario.

A continuación, una tabla que resume el impacto de aplicar las optimizaciones recomendadas en un sitio corporativo típico antes de la intervención técnica.

| Métrica | Antes de la optimización | Después de la optimización | Impacto en SEO |

|---|---|---|---|

| Peso HTML descomprimido | 2.3 MB | 180 KB | Eliminación del truncamiento; indexación completa |

| Tiempo de carga (LCP) | 4.2 segundos | 1.1 segundos | Mejora en Core Web Vitals y experiencia de usuario |

| Scripts Inline | 12 bloques | 0 bloques | Liberación del presupuesto HTML para contenido |

| Imágenes Base64 | 8 imágenes | 0 imágenes | Reducción de peso y mejor gestión de caché |

| Enlaces internos descubiertos | 67 enlaces | 134 enlaces | Rastreo completo del footer y navegación secundaria |

| Schema Markup indexado | Parcial (solo header) | Completo (header + body + footer) | Activación de Rich Snippets en todos los productos |

Esta tabla refleja datos reales de un caso de estudio interno de Presticorp. El cliente, un marketplace b2b, perdía visibilidad en sus categorías de mayor margen porque el schema de producto residía en el footer, truncado por el límite de 2 MB. Tras externalizar recursos y minificar html, recuperó indexación completa en 72 horas y un incremento del 23% en tráfico orgánico en el siguiente mes.

-19-38-20-0513203839.png)

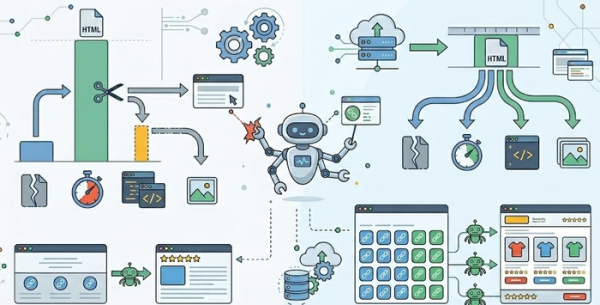

Diagrama comparativo del límite de 2 MB de googlebot. A la izquierda, el peso mediano del html (~30 KB) frente al límite exacto de 2,097,152 bytes. A la derecha, el flujo completo: solicitud http, descarga, truncamiento en 2 MB e indexación parcial. Fuente: captaindns.com

En Presticorp realizamos auditorías técnicas profundas que detectan silenciosamente si tus páginas críticas están siendo indexadas parcialmente. Analizamos el peso real de tu html, la ubicación de tu schema markup y la eficiencia de tu código para garantizar que googlebot capture el 100% de tu contenido estratégico.

-19-39-31-0513203948.png)

Checklist de ocho puntos críticos de seo técnico para 2026, incluyendo rastreabilidad, arquitectura de sitio, velocidad, mobile-first, schema markup, seguridad, canónicas y redirecciones. Fuente: 6smarketers.com

El mensaje que Google envía con esta clarificación documental es inequívoco: la eficiencia técnica ya no es opcional. Con la llegada de la búsqueda generativa (GEO), los motores de respuesta (AEO) y los grandes modelos de lenguaje (LLMS), la forma en que una página está construida determina tanto si será indexada como si será citada por sistemas de inteligencia artificial.

Los LLMS no leen una web como un humano. Procesan tokens, y un html inflado consume tokens valiosos que podrían dedicarse a contenido semántico. Si tu página está saturada de código basura, los modelos de lenguaje tienen menos contexto para entender de qué tratas y menos probabilidades de recomendarte en sus respuestas.

En el contexto de AEO (answer engine optimization), una estructura limpia permite que los extractores de respuestas identifiquen rápidamente definiciones, listas y tablas. Un html caótico dificulta esa extracción y reduce tus opciones de aparecer en posición cero o en overviews generados por IA.

Para GEO (generative engine optimization), la indexación completa es prerequisito. Si Google no indexa tu contenido porque cae después de 2 MB, tampoco puede utilizarlo para alimentar sus modelos generativos. Es una doble penalización: no posicionas en búsqueda tradicional y tampoco apareces en búsqueda generativa.

Como estratega digital que ha auditado sitios en tres mercados distintos (Estados Unidos, México y España), mi recomendación directa es la siguiente: deja de obsesionarte solo con keywords y backlinks. En 2026, el seo técnico es el nuevo link building. Una web rápida, limpia y bien estructurada supera en resultados a una web con autoridad de dominio alta pero con código podrido.

Invierte el 20% de tu presupuesto SEO en contenido y el 80% en infraestructura técnica. Esa proporción, que parece extrema, es la que está separando a los sitios que escalan de los que se estancan. Y si no tienes un equipo técnico interno, contrata una auditoría profesional. El costo de no saber que Google está ignorando la mitad de tu web es infinitamente mayor que el costo de descubrirlo a tiempo.

¿Sabes con certeza si Google está viendo todo tu contenido o solo una parte? La mayoría de los especialistas en seo no lo saben porque google no envía advertencias cuando ocurre el truncamiento. Agenda una cita con Presticorp para una auditoría completa de tu infraestructura SEO. Te entregamos un informe ejecutivo con hallazgos prioritarios y un plan de acción para recuperar la visibilidad que ya deberías tener.

El 90% de los especialistas en seo está ignorando el límite de 2 MB porque google no les advierte cuando sus páginas se truncan. Pero la documentación oficial es clara: si tu html supera ese umbral, el contenido sobrante no existe para el buscador. Schema, canónicas, enlaces internos y texto clave desaparecen sin dejar rastro.

Esto no es un problema para la mayoría estadística, pero sí para la minoría estratégica. Si tu negocio depende de páginas complejas, catálogos masivos o aplicaciones renderizadas del lado del servidor, este límite te está costando dinero real todos los días.

La buena noticia es que la solución está al alcance. No requiere más contenido, sino menos código. No exige más inversión en publicidad, sino una auditoría técnica que revele lo que Google realmente está indexando. En 2026, ganará quien estructure mejor su código, no quien escriba más palabras.

-

-

-

-

-

-

-

-

-

- Google for developers. Inside googlebot: demystifying crawling, fetching, and the bytes we process. Documentación oficial de google central, febrero 2026.

- Illyes, Gary. Publicación oficial en el blog de google search central: what google says about website crawling in 2026. Promotedge, abril 2026.

- Mueller, John. Respuestas en bluesky y reddit sobre límites de googlebot, febrero 2026. Citado en search engine roundtable y seo-kreativ.de.

- Spotibo. We tested google's new 2mb crawl limit. What happens? Febrero 2026.

- Debugbear. What googlebot's 2mb crawl size limit means for seo. Febrero 2026.

- Http archive web almanac 2025. Sección page weight: html bytes. Datos de mediana y percentil 90 en móvil.

- Seobility. Google reduces its crawl limit to 2 mb: what this means. Febrero 2026.

- Captaindns. Googlebot's 2 mb crawl limit: what gets truncated. Febrero 2026.

- Techlooker. Technical seo guide 2026: core web vitals and crawlability. Mayo 2026.

- Keytomic. Google just updated crawl limits to 2mb from 15mb; why it matters and what to do about it. Febrero 2026.

Si tu proyecto requiere una solución más enfocada, entra directo a la landing ideal para tu negocio y envíanos tu información en el formulario correspondiente.

0 Comentarios